Polícia japonesa faz prisões em casos de imagens explícitas geradas por IA: um novo capítulo no debate sobre deepfakes e privacidade

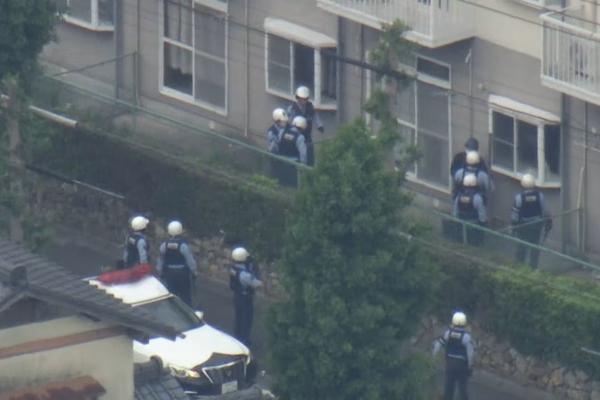

Nos últimos meses, a polícia japonesa intensificou a fiscalização contra o uso malicioso de inteligência artificial (IA) para criar e distribuir conteúdos explícitos, levando à prisão de suspeitos no Japão em casos inéditos envolvendo deepfakes e imagens geradas artificialmente.

Este movimento legal ocorre em meio a um debate mais amplo — tanto no Japão quanto globalmente — sobre ética, privacidade, direitos de imagem e como leis existentes devem ser aplicadas à tecnologia emergente.

Prisões inéditas envolvendo IA e imagens obscenas

📍 Caso de deepfake com celebridades

A polícia de Tóquio prendeu um homem de 31 anos, identificado como Chiba Tatsuro, da cidade de Sapporo, Hokkaido, sob suspeita de utilizar inteligência artificial para criar e divulgar imagens falsas e sexualmente explícitas de celebridades femininas, incluindo atrizes, idols e personalidades da mídia japonesa.

Segundo autoridades e veículos de imprensa, entre janeiro e junho de 2025, o homem teria criado cerca de 20 000 imagens ofensivas de mais de 262 mulheres diferentes usando software de IA, alcançando assinantes por meio de plataformas online e cobrando por acesso aos conteúdos.

Ele foi detido pela Metropolitan Police Department (MPD) de Tóquio por exibição de material obsceno em violação da legislação japonesa, que proíbe a distribuição de conteúdos sexualizados que violam normas públicas mesmo quando gerados artificialmente.

Prisões anteriores por comercialização de imagens obscenas de IA

Antes deste caso de deepfake com celebridades, ocorrera outra ação policial importante: quatro pessoas foram detidas no Japão sob suspeita de criar e vender pôsteres com imagens sexualmente explícitas geradas por IA, marcando um episódio que muitas vezes é citado como o primeiro caso criminal desse tipo no país.

As quatro pessoas — com idades entre os 20 e os 50 anos — teriam usado software de IA para criar imagens indecentes de mulheres que não existem na realidade e as venderam em sites de leilão online por alguns milhares de ienes cada.

Embora não sejam necessariamente deepfakes de celebridades, essa prisão também demonstra que a aplicação de leis de obscenidade e distribuição de imagens indecentes está se estendendo à tecnologia de IA.

🧠 Esses dois casos juntos mostram uma tendência clara: autoridades japonesas estão começando a aplicar leis pré-existentes (como a de distribuição de material obsceno) a conteúdos criados por IA, mesmo quando as “pessoas” retratadas não são reais.

Por que esses casos chamam tanta atenção

🧬 1. Tecnologia acessível e disseminada

Os dispositivos e softwares de IA usados para criar essas imagens não exigem treinamento especializado — muitos deles são gratuitos e facilmente acessíveis a qualquer pessoa com um computador.

📜 2. Lacunas legais e interpretação judicial

No Japão, ainda não existe uma lei específica contra deepfakes ou pornografia gerada por IA, mas a legislação atual tem sido usada para enquadrar essas práticas sob títulos como distribuição de material obsceno (Criminal Code Art. 175).

Isso significa que mesmo quando a imagem não representa uma pessoa real, se ela é considerada “obscena” sob os padrões legais japoneses, a pessoa pode ser responsabilizada criminalmente.

📱 3. Impacto social e reputacional

Mesmo sem ser um caso criminalizado especificamente como “violação de direitos de imagem”, a criação e publicação de conteúdos sexualizados de pessoas que se assemelham a indivíduos reais pode causar danos significativos à reputação e à privacidade daqueles envolvidos — dependendo de como e onde as imagens são usadas.

O que dizem as autoridades e especialistas

Autoridades policiais enfatizam que o simples fato de um conteúdo ser criado por IA não o coloca fora da lei. Se uma imagem gerada digitalmente for considerada obscena ou se for distribuída de maneira ofensiva, ela pode ser enquadrada como crime sob as leis existentes sobre distribuição de material indecente.

Especialistas em tecnologia legal argumentam que esses casos são um alerta para a necessidade de atualização das leis, pois as ferramentas de IA evoluem mais rapidamente do que o aparato jurídico. Há um debate global sobre como equilibrar liberdades tecnológicas com a proteção de direitos individuais.

O que isso significa para usuários e criadores

💡 Para quem usa ferramentas de IA

- Produzir imagens sexualizadas, mesmo de personagens fictícios ou não reais, pode violentar normas legais sobre obscenidade, dependendo do contexto e da forma como essas imagens são distribuídas.

- Legislação atual pode ser usada não apenas para punir distribuidores, mas também para responsabilizar quem publica ou compartilha materiais que violem leis de obscenidade.

📲 Para residentes estrangeiros no Japão

- É importante saber que o conceito de obscenidade no Japão é tratado de forma diferente do que em muitos países ocidentais — leis de censura históricas e normas sociais influenciam a forma como conteúdo sexualizado é classificado e punido.

- Publicar, compartilhar ou vender conteúdos gerados por IA que possam ser considerados indecentes pode resultar em investigações criminais, independentemente de parecer “somente digital”.

Naturalmente, o Japão está dando seus primeiros passos legais explícitos contra o uso indevido de ferramentas de IA para criar e distribuir conteúdos sexualizados.

Esses casos não apenas demonstram que as autoridades estão dispostas a aplicar leis existentes a novos contextos tecnológicos, mas também indicam que discussões sobre regulação específica de deepfakes e conteúdos gerados por IA devem avançar nos próximos meses.

A questão de como equilibrar liberdade de expressão, inovação tecnológica, privacidade e proteção contra abuso não é exclusiva do Japão — é um desafio global, e o país está começando a enfrentar isso de forma prática e judicial